Conception d’une IA physique : les clés du succès en robotique humanoïde

Les modèles d’intelligence artificielle (I.A.) que vous utilisez vont entrer dans le monde physique, grâce à la miniaturisation des processeurs de calcul d’I.A. générative, la communication avec l’humain en langage naturel et en temps réel, et une perception de l’environnement multimodale : non seulement les textes et les images, mais aussi les sons, vibrations, couleurs, odeurs, retours d’effort lors de la préhension, ainsi que tout ce qui a trait aux signaux humains comme les paroles, les mouvements, les émotions exprimées sur les visages et dans les voix.

L’I.A. va révolutionner la robotique. Ce qu’on appelle désormais l’I.A. physique couvre la perception, la décision autonome en temps réel qui tient compte de l’environnement, et l’action. Elle va guider les équipements de demain, que ceux-ci aient l’aspect d’une machine ou d’un robot humanoïde.

La dimension à intégrer pour les concepteurs d’I.A. physique est la relation à l’humain. Car au-delà d’être un simple donneur d’ordres, l’humain fait corps avec le système machine-homme. Il suffit de prendre la mesure de la transformation de nos vies par le smartphone pour entrevoir l’importance des mutations à venir.

Praticiens du design industriel et du marketing de l’innovation, nous proposons une approche pour rendre l’I.A. physique pertinente, acceptable et désirable, en travaillant dès la phase de conception sur deux axes :

- Editorialiser les données d’apprentissage de l’I.A.

- Conférer aux robots des traits de personnalité clairs, afin d’en faciliter l’adoption, parce que l’on comprend intuitivement comment interagir avec eux.

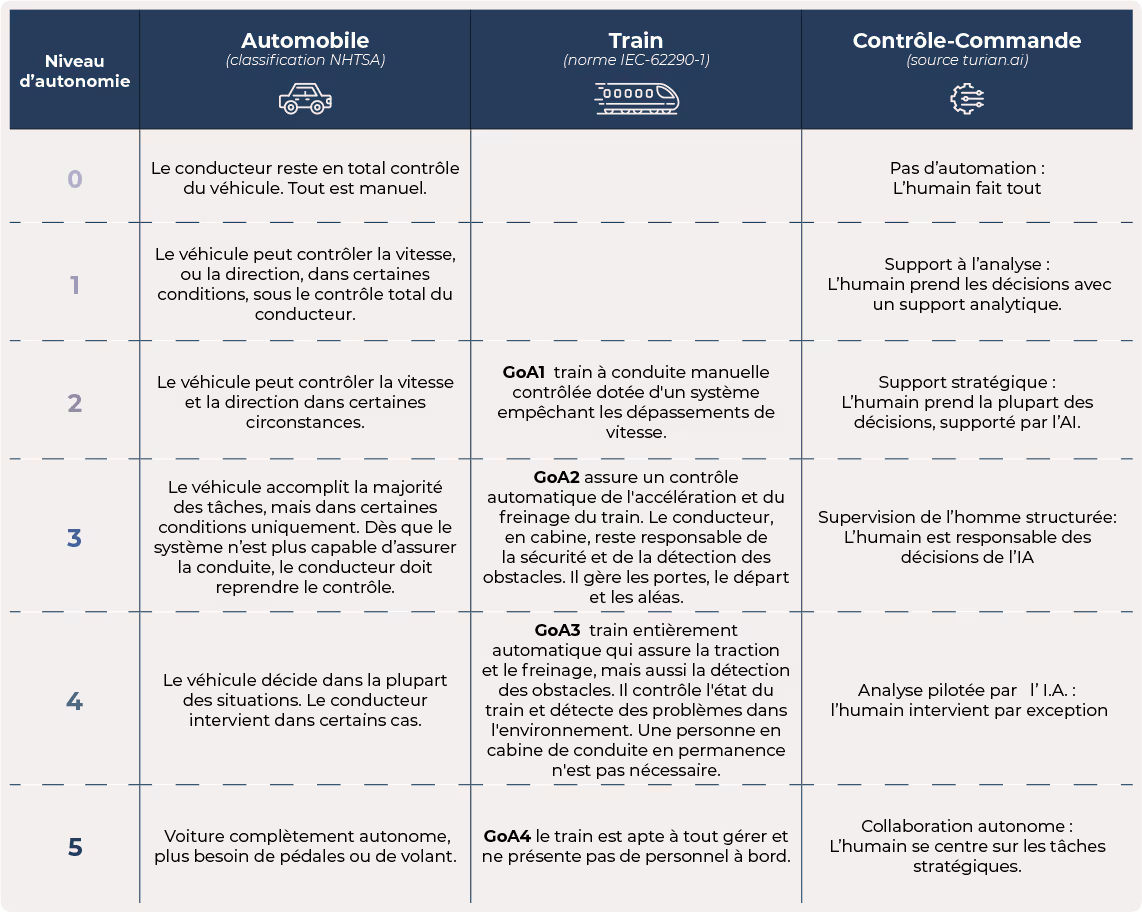

1 — L’échelle d’autonomie actuelle : Une échelle dont la fin est encore moins d’humain.

Jusque-là, le développement de l’autonomie des systèmes s’est fait à l’aune d’une échelle standardisée qui mesure la capacité du système à agir sans l’intervention de l’humain.

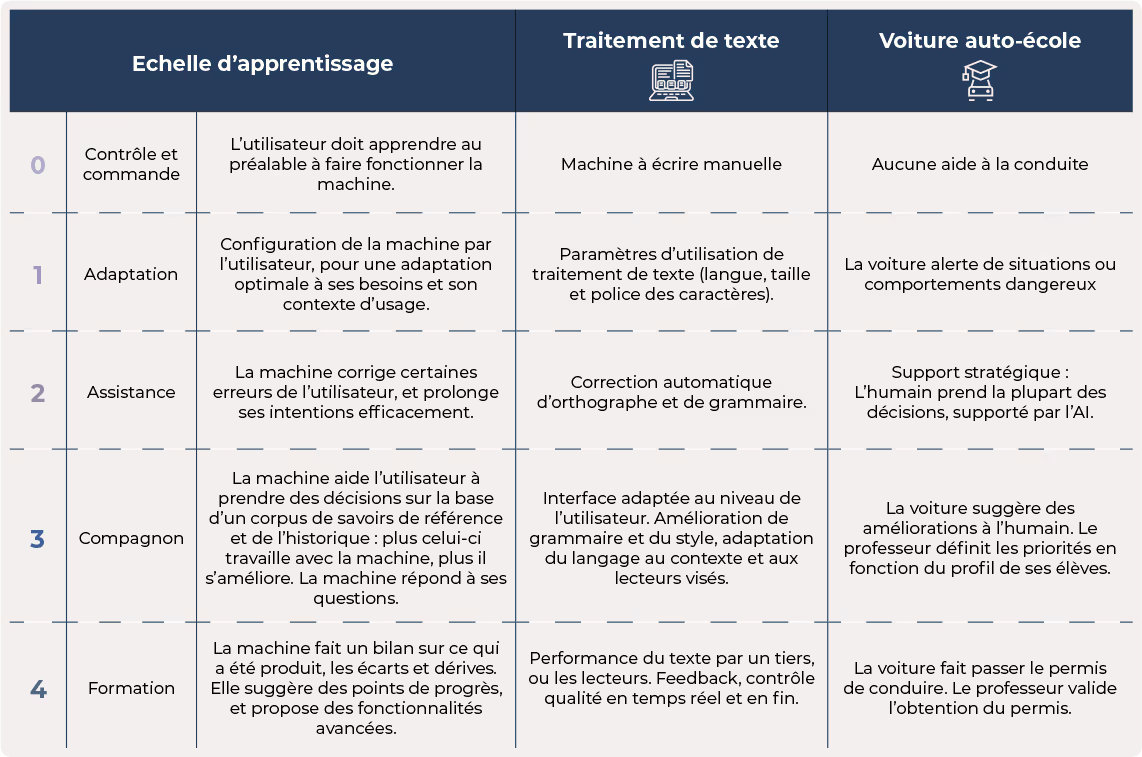

Le tableau ci-dessous présente les niveaux d’autonomie de trois systèmes :

- l’automobile

- le train

- un système de contrôle et commande basé sur l’I.A.

2 — Une métrique techno-centrique

Ces échelles sont nécessaires pour jalonner les efforts technologiques et réduire le taux d’erreurs de décision du système. Mais dès que celui-ci devient plus performant que l’humain, elles ne suffisent plus.

- On dépouille l’humain de ses prérogatives de contrôle et de commande : c’est une perspective qui suscite le rejet. Le véhicule autonome est un cas d’école : depuis dix ans, il a généré beaucoup de perceptions négatives alors qu’il fait beaucoup moins d’erreurs que l’humain par kilomètre parcouru. En effet, l’idée du véhicule autonome va à rebrousse-poil de notre conviction d’être de bons conducteurs. Dans le monde, entre 80 % et 93 % des automobilistes s’auto-évaluent positivement, indépendamment de la réalité du risque routier ou du niveau d’infraction local [1]. Même les plus âgés, dont les capacités de conduite se détériorent, sont rebutés par l’idée d’une autonomie complète du véhicule, alors qu’ils apprécient les aides à la conduite qui compensent leurs déficiences.

- Une fois les performances techniques cibles atteintes, le défi de l’I.A. physique est clair : créer des machines qui préservent ou augmentent les capacités des humains. En prétendant libérer l’humain d’une tâche « pénible », conduire, elle remet en question notre rapport intime à la conduite : que devient le détour décidé à l’improviste en fonction de l’humeur et des circonstances ? Malgré son image écornée par l’urgence écologique, la voiture reste un symbole puissant : celui de la liberté. La voiture autonome qui sera adoptée devra non seulement respecter le code de la route et éviter les accidents. Elle devra s’assumer comme objet social, et agir en fonction des humains à côté.

- Une voiture autonome se conçoit en fonction de son environnement social :

- Elle va générer un impact sur les automobilistes dans le trafic. Certains, par exemple, lui confèreront un statut de véhicule tout en haut de l’échelle sociale, qui mérite déférence et priorité.

- Elle va générer un impact sur les habitants des quartiers traversés. On imagine aisément des adolescents tester ses limites, en lançant exprès un ballon devant. D’autres, moins bienveillants, y verront un exutoire de choix pour exprimer leur révolte. Pas question, dans ce cas, pour une voiture autonome de rester garée dans un quartier dangereux.

- Ses décisions en cas de collision inévitable ont des conséquences sociétales : vaut-il mieux écraser les enfants, ou l’adulte qui les accompagne ? La réponse à ce dilemme éthique variera selon le pays.

- Elle va générer un impact sur les automobilistes dans le trafic. Certains, par exemple, lui confèreront un statut de véhicule tout en haut de l’échelle sociale, qui mérite déférence et priorité.

3 — Développer les interactions avec l’humain sur une variété d’axes

L’analyse du comportement des utilisateurs d’IA révèle une interaction homme-machine forte.

Une étude publiée en décembre 2025 sur les usages de 37,5 millions de Microsoft Copilot indique à quel point les utilisateurs ont intégré l’I.A. au cœur de leurs activités personnelles et professionnelles, faisant de Copilot un véritable compagnon de vie, pour leurs travaux, leurs questions existentielles, leurs difficultés relationnelles .

Le psychiatre Raphaël Gaillard a identifié les causes profondes de cette relation :

« Dans la préhistoire, pour survivre, […] il a fallu à l’humain comprendre l’action ou la réaction d’une bête sauvage. Face à quelque chose doué d’une forme d’intelligence, nous sommes confrontés à une asymétrie d’information : il nous est impossible de savoir l’étendue de cette intelligence dont nous ne percevons que quelques effets visibles, […] nous avons la prudence de considérer que cette intelligence pourrait nous surprendre, et donc de la supposer grande. Vient alors un troisième temps, celui par lequel cette intelligence se révèle capable de dire quelque chose de pertinent. A minima, son comportement similaire au nôtre nous renvoie à ce que nous savons de nous, c’est-à-dire pas grand-chose, créant un lien de fraternité, du moins de communauté de fonctionnement. Cette similarité jette les bases d’une relation dont il ne faut pas sous-estimer l’intensité. Plus encore, si d’aventure cette intelligence se montre capable de qualifier notre fonctionnement […] nous éprouvons pour elle un sentiment d’une autre profondeur. Un mélange de peur, mais aussi d’affection » .

La conception des robots dotés d’I.A. doit considérer ces risques et opportunités de nature anthropologique. Elle doit intégrer en mode natif des dimensions telles que :

- Le rôle des signaux sensoriels et des émotions dans la décision humaine.

- Les rituels de transfert de pouvoir entre l’homme et la machine : comment la machine remet-elle l’utilisateur dans la boucle quand c’est à lui de reprendre la main ? Comment s’assure-t-elle que l’utilisateur ne dort pas ?

- Les besoins de boucles d’apprentissage pour faire progresser l’utilisateur apprenant.

Cette liste n’est pas exhaustive ! Bloc opératoire, école, centre d’éducation spécialisé, atelier de production industrielle, laboratoire, salle de sport, vignoble, zone de combat, point de vente : la variété des usages, des contextes et des utilisateurs va déterminer la façon de mesurer la performance, que ce soit celle de l’utilisateur, de la machine, ou du tandem homme + machine.

Le tableau ci-dessous imagine ce que pourrait être une échelle de performance axée sur la capacité du système à apprendre à l’homme dans le cadre du traitement de texte ou de la conduite automobile. Cette échelle poursuit un double enjeu économique :

- réduire le temps de formation initiale de l’utilisateur à la machine, en le centrant sur les enseignements fondamentaux pour une prise en main rapide, puis en distillant progressivement des approfondissements ;

- faciliter l’accès à certains métiers qualifiés qui peinent à recruter, en accélérant la formation et en ôtant leur pénibilité.

4 — Pour une I.A. physique pertinente, éditorialiser les données d’entraînement

Une étape nouvelle s’invite dans la phase de conception : sélectionner et indexer soigneusement les corpus de données pour entraîner l’I.A. physique.

Prenons l’exemple de la conception d’un garrot pour les premiers soins à donner à un soldat blessé sur le front. Le concepteur veut utiliser l’I.A. générative pour développer le meilleur produit. Son premier défi est que l’emploi d’une I.A. généraliste ouverte n’est pas possible dans le domaine militaire, car les données terrain sont classifiées et les prompts doivent rester confidentiels. Dans une I.A. privative spécialisée, les données d’entraînement devront donc être sélectionnées, formatées et dûment classifiées en amont : provenance des données, contexte, qualité, biais éventuels, traçabilité des versions.

Dans le contexte de la santé aussi, l’éditorialisation des données d’entraînement va s’imposer, ne serait-ce que pour des raisons de conformité à la réglementation européenne sur la sécurité de l’IA. Les modèles d’IA qui utilisent les sources de données reconnues au sein de la spécialité médicale, bien indexées et contextualisées, permettront de garantir la pertinence de l’IA.

Le concepteur va combiner des données d’entraînement sur les produits de premiers secours médicaux et sur les opérations de combat. D’autres données contextuelles peuvent être ajoutées : la souffrance du blessé, son équipement, etc. Le travail du concepteur va consister à orchestrer plusieurs univers et plusieurs contextes, et à choisir parmi plusieurs propositions de l’I.A. générative, par exemple selon le critère du meilleur compromis entre efficacité médicale et facilité d’emploi.

L’éditorialisation consiste aussi à priver l’I.A. de pans entiers d’informations d’entraînement, afin de limiter les risques de mauvaise prise de décision, de réponse vague ou inadaptée (hallucination) par rapport à une mission précise.

Imaginons qu’en tant que parent vous souhaitiez développer pour votre enfant une I.A. de coparentalité. Vous allez souhaiter vous impliquer dans l’éditorialisation, à savoir :

- Les données de contexte : circonscrire les thèmes à aborder, identifier les liens avec la vie scolaire, indiquer les membres de la famille et autres personnes de confiance, préciser comment les contacter, choisir la ou les langues de communication, etc.

- Les données d’entraînement : elles constituent le socle du savoir à transmettre et serviront à construire le raisonnement. Leur éditorialisation passera par les étapes suivantes :

- Filtrage thématique du corpus d’entraînement : en limitant l’apprentissage aux sujets utiles à l’éducation ou au quotidien d’un enfant, l’I.A. réduit son « bruit cognitif » et produit des réponses plus stables et cohérentes.

- Intégration de cadres éducatifs ciblés : en exposant l’I.A. à des valeurs, histoires, approches pédagogiques ou références culturelles, morales ou religieuses choisies, on oriente sa manière d’expliquer, d’encourager ou de répondre — comme si on définissait son « style parental ».

- Exclusion de certains sujets sensibles : en retirant du corpus des thématiques taboues ou inadaptées à l’âge, on réduit le risque que l’I.A. aborde des sujets que vous souhaitez traiter sous votre contrôle. L’I.A. physique doit pouvoir dire : « Je ne sais pas, demande à ton papa ou à ta maman ».

- Pondération de contenus prioritaires : en sur-représentant certains types de contenus, on renforce la capacité de l’I.A. à accompagner l’enfant dans ces domaines spécifiques.

- Construction de scénarios d’usage réalistes autour du quotidien : en entraînant l’I.A. sur des situations concrètes (devoirs, conflits, routines, émotions, questions existentielles), on améliore la pertinence et la prédictibilité de ses réponses dans des moments de vie réels.

- Filtrage thématique du corpus d’entraînement : en limitant l’apprentissage aux sujets utiles à l’éducation ou au quotidien d’un enfant, l’I.A. réduit son « bruit cognitif » et produit des réponses plus stables et cohérentes.

5 — Faciliter l’adoption en conférant au robot une personnalité claire

Un robot dopé à l’I.A. doit être considéré comme un agent social : parfois simple marqueur de présence, parfois membre à part entière d’un système relationnel plus vaste. Il n’existe pas seulement lorsque nous lui parlons ; il existe avec nous, dans un continuum d’attentes, de signaux et de comportements.

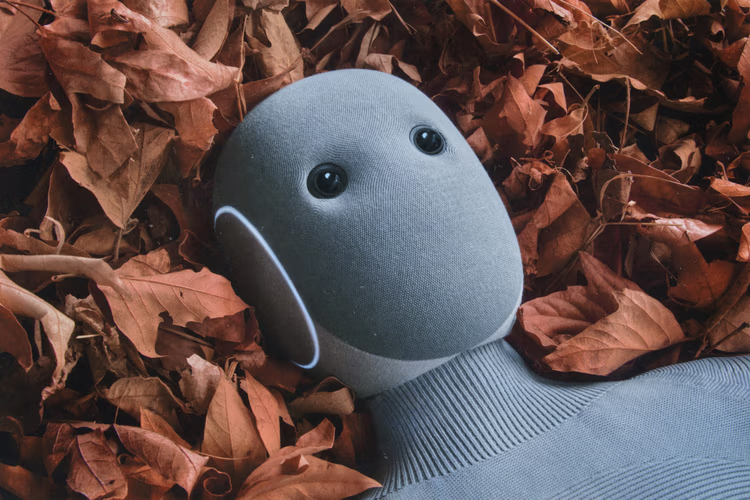

Pour choisir votre premier robot domestique, une grande majorité d’entre vous va préférer faire rentrer à la maison Neo, humble et familier (en bas à droite), plutôt qu’Optimus, robot domestique et multifonctionnel développé par Tesla (en bas à gauche), au look assertif et dominateur.

.avif)

.avif)

Qui sait si, après plusieurs années de cohabitation, nous ne finirons pas par accepter les ordres que l’I.A. physique nous donnera ?

Le concepteur du système d’I.A. physique doit spécifier l’interaction avec l’humain :

- Le robot est-il social ? Si oui, qu’est-ce que l’humain doit ressentir quand il le voit ? Pour quelle tâche est-il incité à l’utiliser ?

- Doit-il montrer de l’empathie ? À quel niveau ?

- Sa mission est-elle la sécurité, la présence rassurante, le contrôle de la qualité, l’enseignement, l’exécution de tâches manuelles ? Est-il expert ou polyvalent ?

Le cas de la conception du robot de surveillance Rotunbot ET-G, testé en 2025 par la police de Wenzhou, en Chine, est éclairant : inspiré du film Rubber de Quentin Dupieux (2010) [1], qui met en scène un pneu qui roule sur lui-même afin d’assassiner tout humain sur son passage, ce robot-pneu doit aider la police à poursuivre et arrêter des individus. Il est doté de diverses fonctionnalités de poursuite, de combat et de capture. Mais surtout, en puisant dans l’imaginaire d’un film, les concepteurs ont cherché à amplifier le pouvoir de dissuasion du robot.

6 — Pour les grandes marques, l’I.A. physique va représenter une opportunité extraordinaire : offrir à leur audience une expérience forte

Les frontières du possible sont repoussées en matière de stratégie de marque. Prenons le cas du fabricant de pneumatiques Michelin, mondialement reconnu à travers son personnage centenaire du Bibendum.

L’I.A. physique du Bibendum va pouvoir s’adresser en direct, de façon personnalisée et interactive, à tous ses publics : les enfants pendant l’épreuve cycliste du Tour de France (en bas à gauche), ou les acheteurs de pneus qui ont besoin de comprendre pourquoi les pneus Michelin justifient un prix plus élevé (en bas à droite)

L’I.A. physique de la marque va permettre aussi d’interviewer les clients en langage naturel, de collecter leurs avis et suggestions, de promouvoir les produits de la marque, et de créer ainsi une expérience mémorable.

L’éditorialisation des données d’entraînement est d’autant plus facile que ces grandes marques s’inscrivent dans un cadre déjà très formalisé : univers, mission, rôle, traits de personnalité, valeurs, contextes d’usage. Elles ont accumulé un corpus de données d’entraînement riche et cohérent : visuels et films publicitaires, rédactionnels, arguments promotionnels, conseils d’usage, etc.

L’I.A. physique va certainement concerner aussi les héros des jeux vidéo, bandes dessinées, films, contes, mythes, histoires, comme les personnages de Walt Disney ou de Harry Potter. Elle va aussi représenter des personnages réels, historiques ou contemporains : mannequins de grandes marques de luxe, stars et vedettes, hommes politiques, dirigeants d’entreprise. L’Albanie a nommé en 2025 un Premier ministre qui était une I.A. générative. Ce n’est qu’un début.

7 — Les facteurs de réussite dans la phase cruciale de conception

Le défi pour les concepteurs des futurs systèmes d’I.A. physique est d’imaginer ces machines au sein d’un écosystème humain, et de concevoir autant ce qu’elles font que ce qu’elles sont, ainsi que la place qu’elles occupent dans nos sociétés.

Le besoin d’un cadre éthique croît avec le niveau d’intensité des relations avec l’utilisateur. L’I.A. a souvent été utilisée pour capter du temps d’attention du grand public, parce que le modèle d’affaires reposait sur la publicité personnalisée. Les choix de conception ont entraîné de l’addiction chez les utilisateurs, en suractivant les circuits de récompense du cerveau et en injectant un flux continu de stimuli.

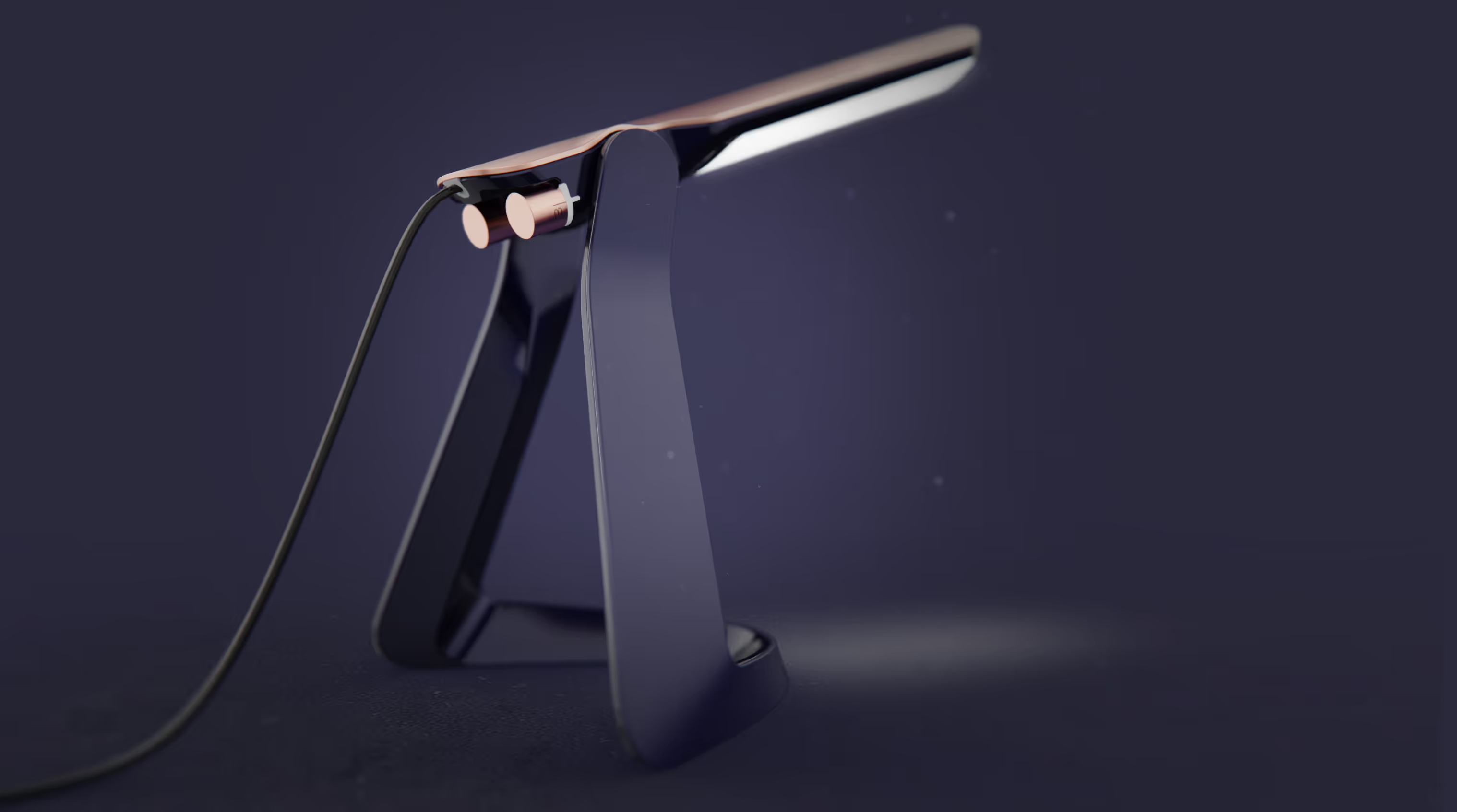

Éviter le piège de concevoir une I.A. physique uniquement pour les moments où elle interagit avec l’utilisateur ou le monde environnant. La meilleure approche est de considérer aussi l’objet en dehors de sa période d’utilisation : phase de recharge, rangement, ou bien réactions en cas d’intempéries, d’intrusion ou de vandalisme.

Le travail de conception implique d’autres disciplines que l’I.A. et la robotique : designers, data scientists, marketeurs, experts du contexte d’usage cible, psychologues, historiens, etc.

L’I.A. physique doit être conçue comme un agent social intégré à un écosystème humain, et non comme un simple système autonome performant. Les métriques actuelles sont trop techno-centriques : elles mesurent l’indépendance vis-à-vis de l’humain plutôt que la coopération avec lui. L’acceptation dépend de la préservation du contrôle, de la clarté des rôles et de la personnalité perçue. Les systèmes intelligents génèrent des relations émotionnelles fortes, ce qui impose une approche anthropologique et éthique. Les données doivent être éditorialisées : sélectionnées, contextualisées, limitées volontairement. La performance doit inclure la capacité à faire progresser l’humain. La personnalité du robot structure l’adoption. Les marques peuvent créer des expériences incarnées. Plus l’intensité relationnelle est forte, plus l’exigence éthique est élevée. La conception doit être interdisciplinaire.